OpenManus部署教程:一步步教你本地部署AI代理

介绍

OpenManus 是一个令人兴奋的开源项目,允许用户在本地机器上部署 AI 代理,连接到强大的大型语言模型。这对于希望探索 AI 技术但不希望依赖云服务的用户来说非常有用。本教程将指导您逐步完成在 Windows 或 macOS 上设置 OpenManus 的过程,确保您能轻松上手。

部署步骤

以下是两种安装方法,适合不同操作系统:

一、使用 Conda(Windows)

- 安装 Python 3.12,从 官方网站 下载。

- 下载并安装 Conda,从 这里 获取。

- 创建 Conda 环境:

conda create -n open_manus python=3.12 conda activate open_manus - 克隆仓库:

git clone https://github.com/mannaandpoem/openmanus cd openmanus - 安装依赖:

pip install -r requirements.txt - 安装并运行 Ollama 模型,例如:

ollama run qwen2.5-coder:14b - 配置 OpenManus:

- 复制并重命名配置文件:

cp config/config.example.toml config/config.toml - 编辑 config.toml,设置模型(如 model = “qwen2.5-coder:14b”)和基础 URL。

- 复制并重命名配置文件:

- 运行:

python main.py

二、使用 uv(macOS)

- 安装 uv:

curl -LsSf https://astral.sh/uv/install.sh | sh - 克隆仓库:

git clone https://github.com/mannaandpoem/openmanus cd openmanus - 创建并激活虚拟环境:

uv venv source .venv/bin/activate - 安装依赖:

uv pip install -r requirements.txt - 安装并运行 Ollama 模型,步骤同上。

- 配置和运行,参考 Conda 方法。

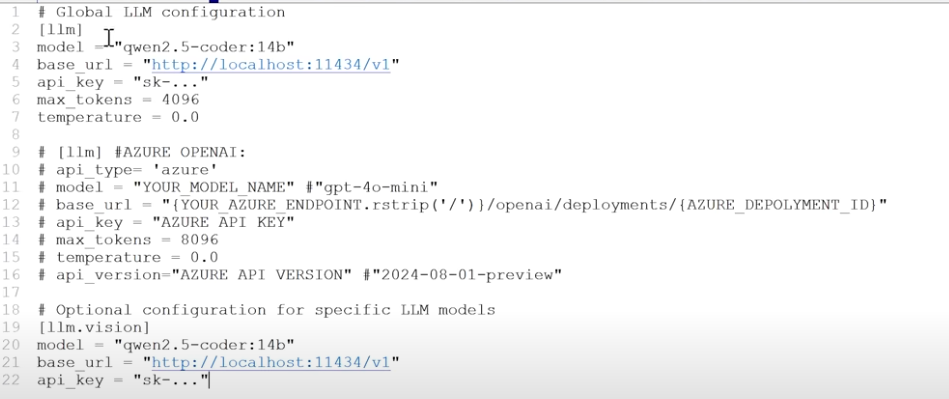

配置详情

编辑 config.toml 文件,设置 LLM 模型、基础 URL(如 http://localhost:11434/v1)和 API 密钥等参数。示例配置包括:

model = "qwen2.5-coder:14b" base_url = "http://localhost:11434/v1"

运行和管理

- 运行命令:

python main.py - 开发版本:

python run_flow.py - 管理模型:

- 列出已安装模型:

ollama list - 删除模型:

ollama rm model_name

- 列出已安装模型:

详细报告

以下是详细分析和扩展内容,旨在为用户提供全面的指导。

项目背景

OpenManus 是一个开源项目,旨在复制 Manus AI 代理的功能,Manus 是一个通用的 AI,能够自主执行复杂任务,如旅行规划和股票分析。OpenManus 由 MetaGPT 的贡献者开发,使用 Python、JavaScript 和 Docker 等技术,提供灵活的平台,支持多代理 AI 系统开发。该项目在短时间内获得了超过 3300 个 GitHub 星标,显示了其社区的广泛关注。

部署准备

部署 OpenManus 需要以下工具:

- Python 3.12:从 官方网站 下载,确保版本正确。

- Conda:Windows 用户从 这里 下载,用于环境管理。

- Ollama:从 官方下载 获取,用于运行本地大型语言模型。

- 支持的模型:包括 qwen2.5-coder:14b、qwen2.5-coder:14b-instruct-q5_K_S、qwen2.5-coder:32b 和 minicpm-v。

安装步骤详解

以下是两种方法的详细步骤,分别适用于 Windows 和 macOS。

方法 1:使用 Conda(Windows)

| 步骤 | 命令/说明 |

|---|---|

| 创建 Conda 环境 | conda create -n open_manus python=3.12;激活:conda activate open_manus |

| 克隆仓库 | git clone https://github.com/mannaandpoem/openmanus;cd openmanus |

| 安装依赖 | pip install -r requirements.txt |

| 安装 Ollama 模型 | 示例:ollama run qwen2.5-coder:14b |

| 配置 OpenManus | 复制配置文件:cp config/config.example.toml config/config.toml;编辑设置 |

| 运行 | python main.py |

下次运行时,激活环境并导航到目录:

conda activate open_manus cd openmanus python main.py

方法 2:使用 uv(macOS)

| 步骤 | 命令/说明 |

|---|---|

| 安装 uv | `curl -LsSf https://astral.sh/uv/install.sh |

| 克隆仓库 | git clone https://github.com/mannaandpoem/openmanus;cd openmanus |

| 创建虚拟环境 | uv venv;激活:source .venv/bin/activate |

| 安装依赖 | uv pip install -r requirements.txt |

| 安装 Ollama 模型 | 同 Conda 方法,例如 ollama run qwen2.5-coder:14b |

| 配置和运行 | 同 Conda 方法,编辑 config.toml 并运行 python main.py |

配置管理

配置文件位于 config/config.toml,需要从 config/config.example.toml 复制并编辑。关键参数包括:

- 模型:如 model = “qwen2.5-coder:14b”

- 基础 URL:如 base_url = “http://localhost:11434/v1”

- API 密钥和其他设置,如 max_tokens = 4096、temperature = 0.0。

运行和模型管理

运行 OpenManus 使用:

python main.py

开发版本可尝试:

python run_flow.py

模型管理命令:

- 列出模型:ollama list

- 删除模型:ollama rm model_name,例如 ollama rm gemma2:27b。

社区和贡献

OpenManus 欢迎社区参与,可通过电子邮件 ([email protected] (mailto:[email protected])) 或 GitHub 提交问题和拉取请求。社区群组在 Feishu,相关图片见 GitHub 仓库。

额外信息

该项目由 MetaGPT 社区贡献者构建,感谢相关项目如 anthropic-computer-use (GitHub 链接) 和 MetaGPT (GitHub 链接) 的支持。许可为 MIT (开源许可),Discord 社区链接为 Discord。

结论

通过以上步骤,您可以成功在本地部署 OpenManus,连接到本地大型语言模型,探索 AI 代理的潜力。该项目持续发展,建议关注 GitHub 仓库 获取最新更新。

关键引用

Comments